Voici de nouveaux éléments sur les lunettes intelligentes que devrait lancer cette année la firme de Mountain View.

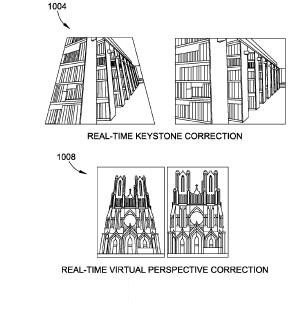

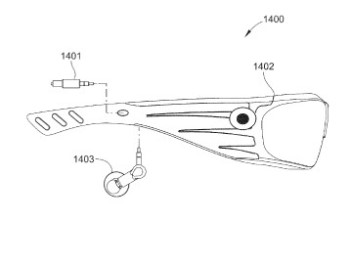

Les Google Glasses seront équipée d’un stabilisateur numérique et d’un détecteur de mouvement. Les images projetées sur les verres seront ainsi corrigées en temps réel selon que le dispositif aura détecté un mouvement ou vibration. La stabilisation numérique devrait également traiter le « bruit » lié à une mauvaise communication hertzienne.

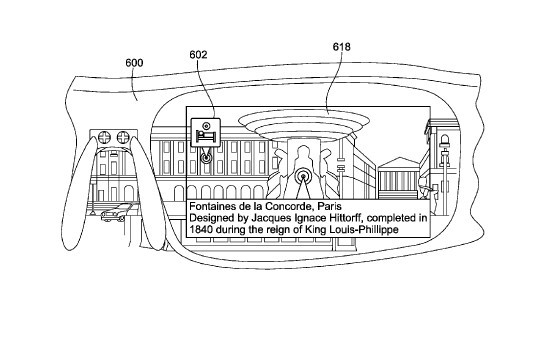

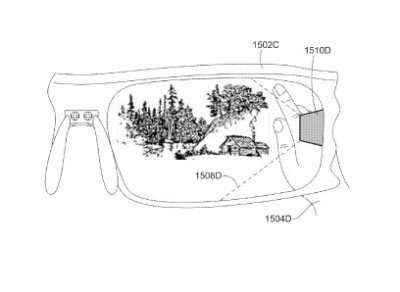

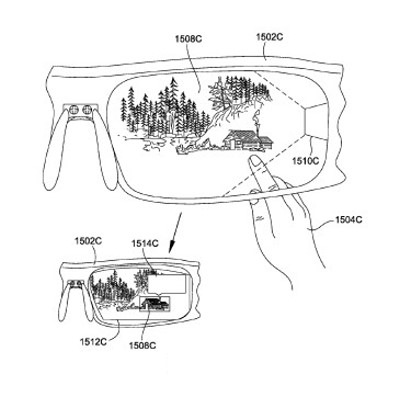

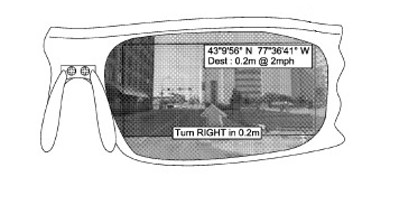

Les lunettes de Google seront équipées d’un système comprenant au moins un appareil photo et un ensemble optique à travers lequel un utilisateur verra l’environnement extérieur comme il le ferait avec des lunettes ordinaires. La différence réside en la possibilité d’incruster de l’information spécifique au monde réel. Ce concept de réalité augmentée permettra par exemple de visualiser des informations en rapport à un monument.

| Pour que soit possible cette incrustation de texte sur l’image, les Google Glasses s’appuieront très probablement sur ses différents référentiels cartographiques (Google Map, Street View…) collectés autre par les fameuses Google Cars et peut être sur des référentiels de type collaboratif qui permettront par exemple de visualiser des commentaires laisser par des amis sur un restaurant ou une boutique. |  |

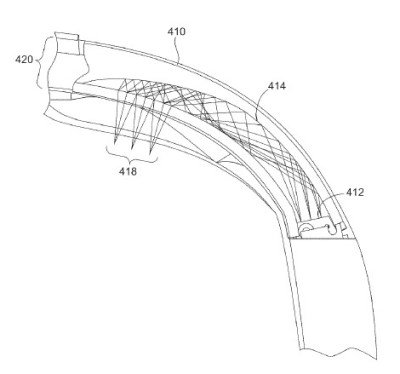

Des capteurs pour ajuster et corriger les images

Des capteurs situés à l’intérieur des branches détecteront les vibrations mais aussi l’inclinaison de la tête. Il est possible que des capteurs de type télémétrique, détecteurs de mouvement, accéléromètres, capteurs de vitesse angulaire et gyroscopes soient intégrés au dispositif.

|  |

Ceci permettra de corriger l’image projetée sur les verres et ajustera la taille de l’image incrustée selon la perspective et la distance des bâtiments avoisinants.

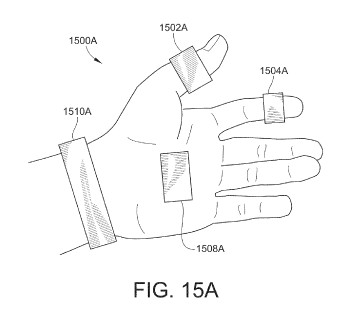

Pilotables au doigt et à l’œil

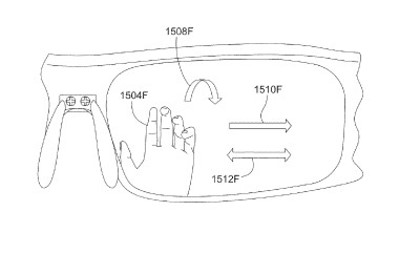

La position des lunettes les rendant étant assez peu manipulable, l’utilisateur aura possibilité d’interagir sur l’image par le biais de gestes spécifiques comme en pointant du doigt un objet ou un bâtiment par exemple.

|  |

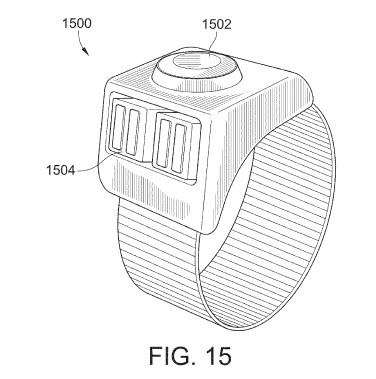

Les Google Glasses devraient être fournies livrées avec un ou plusieurs anneaux voire un bracelet électronique permettant de les contrôler à distance (faire défiler les informations, ou définir l’application à exécuter).

|  |

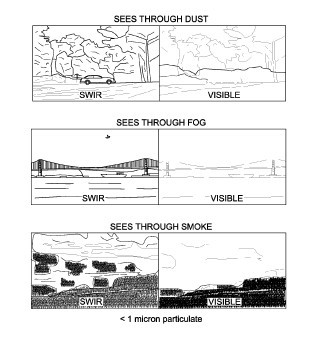

Amélioration de l’image

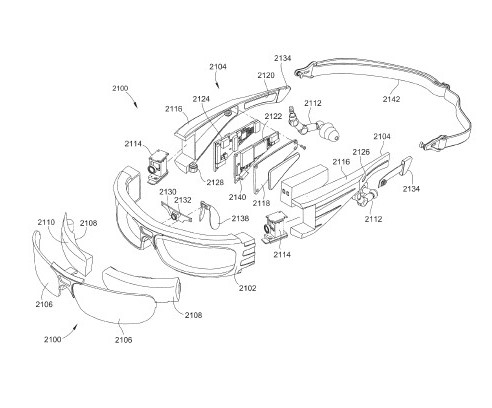

Les Google Glasses devraient être équipée d’une caméra infrarouge (MIR, capteur SWIR ?) grâce à laquelle des techniques d’amélioration d’image seront rendues possibles y compris par faible luminosité. Les lunettes intelligentes devraient ainsi être en mesure d’améliorer les images dont la qualité est altérée (présence de poussière, de brouillard ou encore de fumée).

|  |

Tout sauf des lunettes classiques

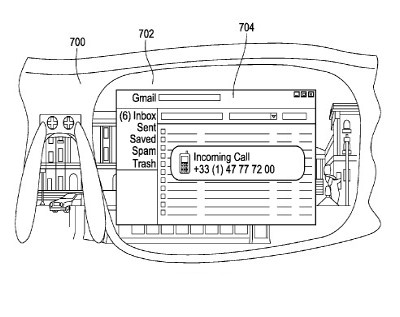

Les Google Glasses permettront aussi de téléphoner et d’écouter la radio, évidemment, et il est probable que le concept donne le jour à des applications variées et innovantes.

Des applications de toutes sortes et pour tous les goûts pourraient être exécutées sur le système Androïd.

Ici une application de navigation :

Ces applications de type « services hébergés » pourraient être louées ou achetées en ligne comme c’est déjà le cas avec les Smartphones. Le stockage des données utilisateurs pourrait se faire soit localement, dans la mémoire physique de la lunette mais c’est peu probable, soit de façon déportée, sur un serveur distant.

A l’instar des téléphones portables de nouvelle génération, qui ont permis l’émergence de nombreuses applications à base de géolocalisation, on peut penser que les lunettes intelligentes de Google, construites autour de composants High Tech, vont donner naissance à de nouveaux types d’application, à base de réalité augmentée et diffusant de l’information contextuelle.

Et si les lunettes intelligentes de Google était un pas de plus vers l’ubimedia ?